日前,英伟达2023 财年第一季度财务报告发布,创下 82.9 亿美元的季度收入纪录,较去年同期增长46%,较上一季度增长8%,其中,数据中心和游戏收入均创下季度纪录。

在最近的COMPUTEX 2022上,英伟达展示了在数据中心、机器人、边缘计算等方面的创新和生态进展。

“三芯”布局即将成型,未来数据中心拼什么?

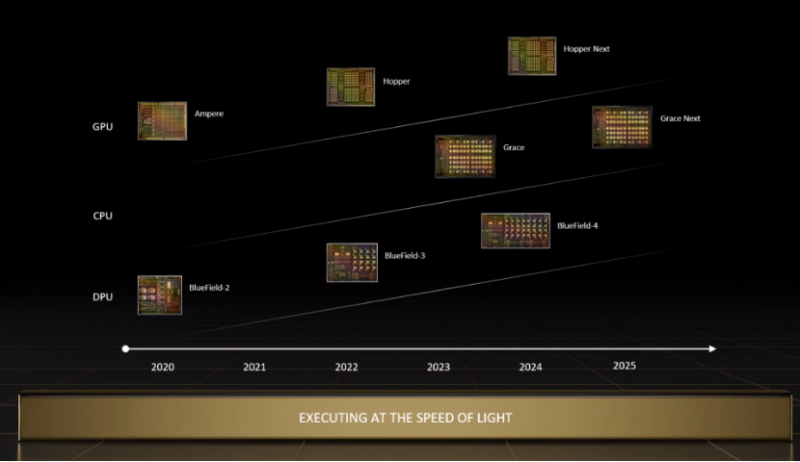

英伟达在最近的两场GTC大会上发布了Grace CPU和Grace Hopper超级芯片,用以支持多种系统架构中的各类计算密集型工作负载。随着这两款超级芯片于2023年上半年开始供货,英伟达CPU+GPU+DPU的产品组合完全形成,这无疑将进一步巩固英伟达在加速计算领域的地位。

与此同时,全球数据中心的竞争也将更有看点。AMD在加快异构计算平台的搭建和创新,英特尔更强大的CPU、独立GPU、新的制程工艺也将在接下来几年内推出。竞争似乎将更为复杂、更为激烈。如何看待2023年之后的数据中心芯片市场?如何持续打造竞争优势?

黄仁勋告诉<与非网>,友商都非常优秀,不过,英伟达会专注于非常独特的发展方式。他指出,人们通常认为英伟达是一家芯片公司,但事实上,英伟达在很多方面都是一家垂直整合的人工智能公司,构建了完整的软件堆栈、芯片、系统、系统软件和人工智能算法等,以开放的方式向生态系统提供产品。不论用户是想采用英伟达的芯片、系统,还是系统软件、AI方案,英伟达都可以为用户提供服务。

他强调,加速计算的世界与CPU截然不同,在CPU的世界中,一个不可思议的魔法叫做x86,每个运行x86的软件都在CPU上运行。然而,没有用于加速计算的x86。

“因此,每一个加速计算系统、芯片或架构都是英伟达的架构,你必须去建立自己的市场”,他表示,“在英伟达的加速计算平台上运行的应用程序都来之不易,因为我们非常努力地加速分子动力学、量子化学、强化学习,或是RNN、CNN、Transformers、LSTM等,这其中包括很多不同的算法,我们必须使其在英伟达的平台上运行良好。我们的做法是成为一家全方位的公司,为客户带来价值,允许平台开放,让用户可以按其所需地集成我们的芯片和技术。”

英伟达创始人兼CEO黄仁勋在Computex 2022期间接受<与非网>采访

首次推出液冷GPU,打造绿色数据中心

为了遏制气候变化,打造高性能、高能效的数据中心,数据中心运营商希望淘汰用于冷却数据中心内部气体的冷水机组,因为它们每年会蒸发数百万加仑的水量。而借助液冷技术,系统仅需对封闭系统中的少量液体进行循环利用,并能够着重于主要的发热点。

液冷技术诞生于大型机时代,在 AI 时代日臻成熟。如今,液冷技术已经以直接芯片(Direct-to-Chip)冷却的形式广泛应用于全球高速超级计算机。

日前,英伟达发布了率先采用直接芯片(Direct-to-Chip)冷却技术的数据中心 PCIe GPU,这在主流服务器GPU中尚属首例,助力实现可持续、高效的计算。

英伟达GPU在AI推理和高性能计算方面的能效已比CPU高出20倍。有数据表面,如果将全球所有运行AI和HPC的CPU服务器切换为GPU加速系统,每年可节省高达11万亿瓦时的能源,节约的能源量可供150 多万套房屋使用一年。

Equinix 是一家全球服务提供商,旗下管理的数据中心超过 240 个,致力于在业内率先实现气候中和。Equinix 正在验证 A100 80GB PCIe 液冷 GPU 在其数据中心的应用,这也是该公司为实现可持续性冷却和热量捕获的综合性方案中的一部分。GPU 现已进入试用阶段,预计将于今年夏季正式发布。

“这是我们实验室中引入的首款液冷 GPU,我们倍感兴奋,因为客户迫切希望通过可持续的方式来利用 AI,”Equinix 边缘基础设施主管 Zac Smith说道。

电源使用效率(PUE)用于衡量数据中心使用的能源有多少直接用于计算任务。当前,数据中心运营商正试图将 PUE 降至接近 1.0 的理想水平。Equinix 设施目前的平均PUE为 1.48,而其旗下新数据中心的 PUE 最低可低于 1.2。

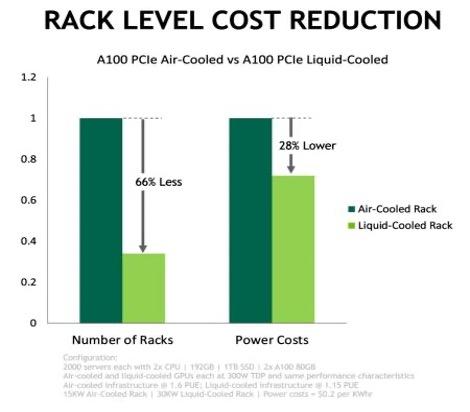

在单独的测试中,Equinix 和英伟达均发现:采用液冷技术的数据中心工作负载可与风冷设施持平,同时消耗的能源减少了约 30%。英伟达估计,液冷数据中心的 PUE 可能达到 1.15,远低于风冷的 PUE 1.6。

在空间相同的条件下,液冷数据中心可以实现双倍的计算量。这是由于 A100 GPU 仅使用一个 PCIe 插槽,而风冷 A100 GPU 需使用两个 PCIe 插槽。

NVIDIA 借助液冷技术达到了节省电力和增加密度的效果

据了解,英伟达计划于明年推出的一版 A100 PCIe 卡中,将搭载基于Hopper架构的H100 Tensor Core GPU。近期内,英伟达计划将液冷技术应用于自有高性能数据中心GPU和 NVIDIA HGX 平台。

数据中心是数字基础设施的重要载体。在“双碳”目标大背景下,减少碳排放、节能减排是重中之重。这将带动数据中心液冷技术的加速应用,推动液冷数据中心解决方案的需求增长。

此外,液冷技术的使用范围并不局限于数据中心,汽车和其他系统也需要利用该项技术来冷却封闭空间内的高性能系统。液冷GPU 在减少能耗的同时可维持性能不变,从目前的市场进展来看,一些系统制造商已经先行启动使用计划,下一步有望快速在更大规模的应用中落地。

据了解,至少有十几家系统制造商计划于今年晚些时候在其产品中使用液冷 GPU,包括华硕(ASUS)、永擎电子(ASRock Rack)、富士康工业互联网(Foxconn Industrial Internet)、技嘉科技(GIGABYTE)、新华三(H3C)、浪潮(Inspur)、英业达(Inventec)、宁畅(Nettrix)、云达科技(QCT)、 超微(Supermicro)、 纬颖科技(Wiwynn)和超聚变(xFusion)。

多家厂商发布首批基于Grace超级芯片的系统设计

新的数据中心需求正在兴起,即通过处理和挖掘海量数据来实现智能的“AI工厂”,而基于英伟达Grace超级芯片的新系统,将为全球新市场和行业注入加速计算的力量。目前,多家计算机制造商宣布将发布首批基于Grace CPU超级芯片和Grace Hopper超级芯片的系统,这些系统将用于数字孪生、AI、HPC、云图形和游戏等各类工作负载。

预计从2023年上半年开始,华硕、富士康工业互联网、技嘉科技、云达科技、超微和纬颖将陆续推出几十款服务器。基于Grace的系统将与x86和基于Arm的服务器一同提供广泛的选择空间,助力其数据中心实现高性能和高效率。

基于Grace CPU和Grace Hopper超级芯片,即将推出的服务器有四类系统设计:

NVIDIA HGX Grace Hopper系统:用于AI训练、推理和HPC,搭载Grace Hopper超级芯片和BlueField-3 DPU。

NVIDIA HGX Grace系统:用于HPC和超级计算,采用纯CPU设计,搭载Grace CPU超级芯片和BlueField-3。

NVIDIA OVX系统:用于数字孪生和协作式工作负载,搭载Grace CPU超级芯片、BlueField-3和NVIDIA GPU。

NVIDIA CGX系统:用于云图形和游戏,搭载Grace CPU超级芯片、BlueField-3和NVIDIA A16 GPU。

Grace CPU和Grace Hopper超级芯片服务器设计组合包括单路、双路和四路配置的单底板系统,服务器制造商可根据客户需求,为这些系统自定义以上四种特定工作负载的设计。

并且,英伟达也正在扩展NVIDIA认证系统计划,以涵盖采用Grace CPU和Grace Hopper超级芯片的服务器以及X86 CPU。预计首批OEM服务器认证将在合作伙伴系统出货后不久完成。

AI掀起新一轮机器人技术革命

机器人正在成为AI主要的新应用。根据英伟达的发布,全球有30多家合作伙伴将推出首批基于NVIDIA Jetson AGX Orin的生产系统。十几家中国台湾的摄像头、传感器和硬件供应商将推出新产品,用于边缘AI、AIoT、机器人和嵌入式应用。

Jetson Orin具有NVIDIA Ampere架构GPU、Arm Cortex-A78AE CPU、下一代深度学习和视觉加速器、高速接口、更快的内存带宽并支持能够为多个并发AI应用管道提供数据的多模态传感器。

全新Jetson AGX Orin生产模块能够为边缘AI带来服务器级的性能。该模块将于7月上市,Orin NX模块将于9月上市。NVIDIA Jetson AGX Orin开发者套件自3月的GTC大会开始在全球全面上市,该套件可提供每秒275万亿次运算性能。在针脚兼容性与外形尺寸相同的情况下,其处理能力超过前代产品NVIDIA AGX Xavier 8倍。

写在最后

在全球宏观环境充满挑战的背景下,英伟达最新的季度财报无疑进一步增强了他们在加速计算领域的雄心。特别是在游戏创下季度业绩纪录的同时,数据中心终于成为了英伟达最大的业务。这表明深度学习对智能自动化的效用,已经大规模推动了英伟达的产品在数据中心用于AI计算。

英伟达正在为下一步大规模的产品上新做准备,全新的GPU、CPU、DPU和机器人处理器将于下半年陆续上市。随着这些新的芯片和系统进入市场,将会进一步推动AI、图形、Omniverse、自动驾驶和机器人的发展,也将进一步驱动相关行业的创新。

1617

1617