2024年大型CSPs(云端服务业者)及品牌客户等对于高阶AI服务器的高度需求未歇,加上CoWoS原厂台积电及HBM(高带宽内存)原厂如SK hynix(SK海力士)、Samsung(三星)及Micron(美光科技)逐步扩产下,于今年第2季后短缺状况大幅缓解,连带使得NVIDIA(英伟达)主力方案H100的交货前置时间(Lead Time)从先前动辄40-50周下降至不及16周,因此TrendForce集邦咨询预估AI服务器第2季出货量将季增近20%,全年出货量上修至167万台,年增率达41.5%。

TrendForce集邦咨询表示,今年大型CSPs(云端服务供应商)预算持续聚焦于采购AI服务器,进而排挤一般型服务器成长力道,相较于AI服务器的高成长率,一般型服务器出货量年增率仅有1.9%。而AI服务器占整体服务器出货的比重预估将达12.2%,较2023年提升约3.4个百分点。若估算产值,AI服务器的营收成长贡献程度较一般型服务器明显,预估2024年AI服务器产值将达1,870亿美元,成长率达69%,产值占整体服务器高达65%。

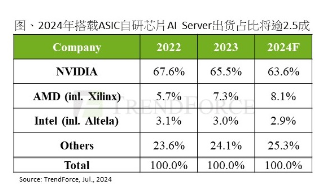

从AI服务器搭配AI芯片类型来看,来自北美CSPs业者(如AWS、Meta等)持续扩大自研ASIC(专用集成电路),以及中国本土业者如:阿里巴巴、百度、华为等积极扩大自主ASIC 方案,促ASIC服务器占整体AI服务器的比重在2024年将提升至26%,而主流搭载GPU的AI服务器占比则约71%。

就AI服务器搭载的AI芯片供应商分布来看,单看AI服务器搭载GPU,英伟达市占率最高、逼近9成,AMD(超威)市占率则仅约8%。但若加计所有AI服务器用AI芯片包含GPU、ASIC、FPGA(可编程逻辑阵列),英伟达今年市占率则约64%。

据TrendForce集邦咨询的调查,展望2025年市场对于高阶AI服务器需求仍强,尤其以英伟达新一代Blackwell(包含GB200、B100/B200等)将取代Hopper平台成为市场主流,此亦将带动CoWoS及HBM等需求。以英伟达的B100而言,其芯片尺寸将较H100翻倍,会消耗更多的CoWoS用量,预估2025年主要供应商台积电的CoWoS生产量规模至年底总产能可达550k-600k,成长率逼近8成。另以HBM用量来看,2024年主流H100搭载80GB HBM3,到2025年英伟达Blackwell Ultra或AMD MI350等主力芯片,将搭载达288GB的HBM3e,单位用量成长逾3倍,随AI服务器市场需求持续强劲下,有望带动2025年HBM整体供给量翻倍成长。

芯耀

芯耀

789

789

下载ECAD模型

下载ECAD模型